Lokakuussa 2025 julkistettu laaja tutkimus (EBU & BBC 2025a) varoittaa, etteivät tekoälyavustajat ole luotettavia uutislähteinä. 45 %:ssa vastauksista oli vähintään yksi merkittävä ongelma. Joka viidennessä vastauksessa oli suoria asiavirheitä, kuten vääriä nimiä, päivämääriä, tilastoja tai keksittyjä tapahtumia. Yleisin virheluokka liittyi lähteisiin: 31 % vastauksista antoi puutteellisia tai virheellisiä viittauksia, mutta loi kuitenkin usein vaikutelman, että tieto oli peräisin arvostetusta uutislähteestä.

Erityisen heikosti suoriutui Google Gemini, jonka vastauksista 72 %:ssa löytyi vakavia lähdeongelmia. Tutkimus oli tähän astisista mittavin: 271 ammattitoimittajaa 18 maasta testasi neljää suosituinta tekoälypalvelua (ChatGPT, Microsoft Copilot, Google Gemini ja Perplexity) ja analysoi lähes 3 000 vastausta. (EBU & BBC 2025a)

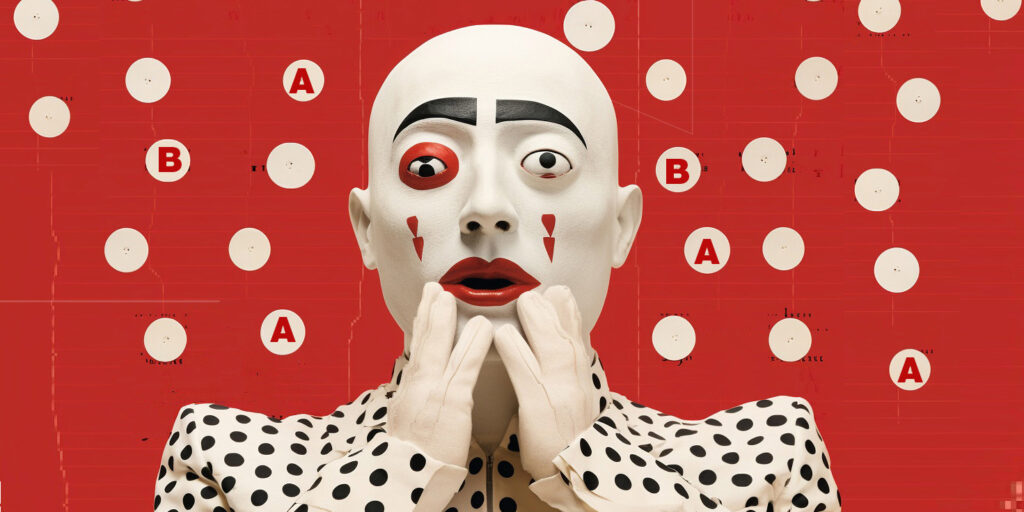

Totuusilluusio – kun tekoäly kuulostaa vakuuttavalta

Tutkijat kutsuvat ”totuusilluusioksi” ilmiötä, jossa tekoäly kirjoittaa sujuvasti ja vakuuttavasti puutaheinää. Tekoälyn tuottama teksti on uskottavan oloista, vaikka tieto olisi virheellistä ja sitaatit tai lähteet keksittyjä. Turvallisuuden tunne syntyy siitä, että vastaukset ovat muodoltaan moitteettomia ja selkeitä. Selvityksessä juuri tämä näennäinen vakuuttavuus nähdään ongelmana, joka alkaa varkain hämärtää totuuden ja keksityn rajoja. Raportti nimeää tekoälyn tavan lisätä omiaan toimitukselliseen tekstiin ”editorilisaatioksi” (EBU & BBC 2025a, 44). Editorilisaation prosessissa mielipiteet, faktat ja arviot muodostavat lopulta sekametelisopan, jota lukijan on vaikea purkaa. Kaikilta ei löydy motiivia ja aikaa syvempään tarkasteluun, joka paljastaisi virheet.

Eräs tekoälyn valuvioista on sen kyvyttömyys ilmaista epävarmuutta. Tekoäly ei osaa sanoa ”en ole varma”. Sen sijaan se keksii vastauksen aukon täyttämiseksi. Kuten raportti toteaa: ”Tekoäly ei toimi kuten hyvä journalisti eli kerro, mitä asiasta tiedetään ja mitä ei” (EBU & BBC 2025a, 24). Syy on tekoälyn koulutuksessa: kielimalleja palkitaan arvailusta, ei tietämättömyyden tunnustamisesta. Tutkijat kehottavat tekoälykehittäjiä priorisoimaan faktantarkistusta ja lähdekritiikkiä. Toistaiseksi vastuu on kuitenkin käyttäjällä: Todellinen tekoälyosaaminen ei tarkoita ohjelmien hallintaa, vaan kykyä erottaa tosi, epätosi ja epävarma toisistaan.

Miten tämän tulisi muuttaa opetusta?

Tekoälyn yleistyessä kriittisyyden opettamisesta tulee entistä tärkeämpää. Kyse on tekoälyn älykkäästä ja tietoisesta käytöstä. Tekoälyä ei tule ajatella itsenäisenä älynä, vaan ”megapeilinä”, jonka kanssa asioita voi pallotella. Tekoäly toimii todennäköisyyden, ei vastuullisuuden logiikalla. Sen ensisijainen tavoite on antaa vakuuttavalta vaikuttava vastaus mahdollisimman nopeasti, eikä se välttämättä erota totta epätodesta. Siksi inhimillinen harkinta, lähdekritiikki ja eettinen lukutaito ovat tärkeämpiä kuin tekninen osaaminen.

Kun opiskelija saa tekoälyltä vastauksen, hänen tulisi esittää itselleen ensimmäinen kysymys: ”Mistä tämä on peräisin?”

Käytännön opetusmenetelmiä voivat olla esimerkiksi:

- Lähdevertailu: Opiskelijoiden tulee etsiä tekoälyn esittämä alkuperäinen lähde ja verrata sitä tekoälyn versioon. Alkuperäinen lähde ei tarkoita yleistä viittausta kirjaan tai artikkeliin, vaan sitä tekstikatkelmaa, mistä tekoäly on johtanut vastauksen.

- Monen tekoälyn analyysi: Opiskelijoille voidaan antaa tehtäväksi kysyä sama asia usealta eri tekoälyltä ja analysoida, miten vastaukset eroavat. Näin syntyy oivallus: mikään vastaus ei olekaan neutraali totuus.

BBC ja EBU kehittävät News Integrity Toolkit -ohjeistoa, jonka tarkoituksena on auttaa mediaa, teknologiayrityksiä ja koulutusorganisaatioita ymmärtämään, miten tekoäly muokkaa käsitystämme totuudesta (EBU & BBC 2025b). Koska emme voi tietää mihin suuntaan tekoäly kehittyy ja kuinka tekoäly-yritykset suhtautuvat EBU:n ohjeiston kaltaisiin aloitteisiin – ne voidaan tulkita kielteisesti turhana sääntelynä – korkeakoulujen on opetettava tulevaisuuden ammattilaiset epäilemään, kysymään ja tarkistamaan enemmän.

Kirjoittaja

Harri Heikkilä toimii LAB-ammattikorkeakoulussa visuaalisen viestinnän ja UX/UI:n yliopettajana ja osallistuu suunnittelijana luovien alojen SOLA-hankkeen täydennyskoulutukseen (linkki hankkeen verkkosivuille), mm. tekoälyä koskevalla sisällöllä.

Lähteet

EBU & BBC. 2025a. News Integrity in AI Assistants: An International PSM Study. BBC Research & Development / EBU Media Intelligence Service. Viitattu 23.10.2025. Saatavissa https://www.ebu.ch/Report/MIS-BBC/NI_AI_2025.pdf

EBU & BBC. 2025b. News Integrity in AI Assistants Toolkit. EBU Media Intelligence Service / BBC Research & Development, Geneve – London. Viitattu 23.10.2025. Saatavissa https://www.ebu.ch/files/live/sites/ebu/files/Publications/MIS/open/EBU-MIS-BBC_News_Integrity_in_AI_Assistants_Toolkit_2025.pdf

Linkit

Linkki 1. SOLA-hanke. 2025. Verkkosivut. Viitattu 27.10.2025. Saatavissa https://luovuudensola.fi